Jeff Dean盛赞姚班校友AI新研究,目前人已到Meta

(来源:量子位)

谷歌AI掌舵人Jeff Dean点赞了一项新研究,还是出自清华姚班校友钟沛林团队之手。

Nested Learning嵌套学习,给出了大语言模型灾难性遗忘这一问题的最新答案!

简单来说,Nested Learning(下称NL)就是让模型从扁平的计算网,变成像人脑一样有层次、能自我调整的学习系统。

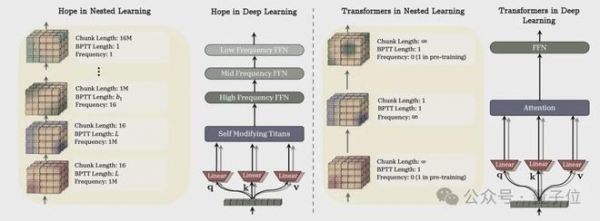

论文里还提到,甚至人们常用的Transformer,其实本质是NL的简化版,它只是把NL的多层级拆成了单一层级的线性层,并没发挥出多层级的优势。

基于NL范式的Hope模型,在语言建模任务和长上下文记忆任务中的表现均优于Transformer,且论文已经被NeurIPS 2025接收。

下面就来看看这个新范式,究竟突破在何处?

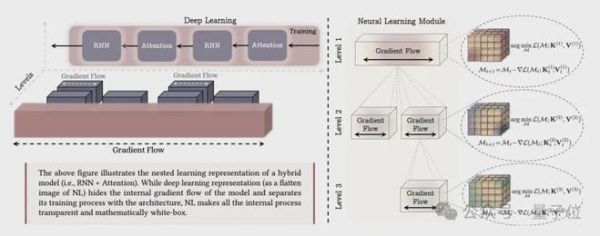

Nested Learning的核心逻辑很明确,即复杂AI模型不是“固定架构+独立算法”的组合,而是由多个嵌套/并行的「优化问题」构成的系统

在大语言模型领域,一个核心痛点始终制约着技术突破,那就是模型仿佛患上了顺行性遗忘症。

预训练完成后便难以持续吸收新知识,只能依赖有限的上下文窗口或固化的历史参数,无法像人类一样实现知识的动态积累与迭代。

与此同时,传统深度学习依赖的堆层扩参模式也逐渐触及瓶颈,增加网络层数或放大模型规模往往无法带来预期中的能力提升,甚至可能导致训练低效、泛化能力不足等问题。

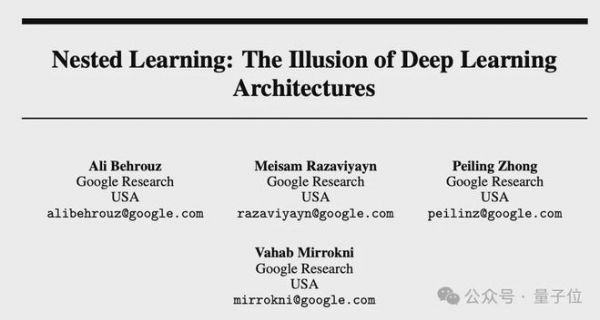

而嵌套学习NL则开辟了一条模仿人脑认知机制的新路径,灵感就源自于大脑的记忆工作原理。

人类大脑通过在线巩固离线巩固两个互补的过程实现持续学习,短期内记忆快速更新,长期记忆则缓慢沉淀,不同层级的记忆系统按照各自的节奏协同运作。

NL就是把这一套逻辑数字化,把机器学习模型重构为一套嵌套式的、多层级的优化体系,每个层级都拥有独立的上下文流和更新频率。

不同于传统深度学习扁平式的参数更新模式,NL中的每个组件都像是一个专属的联想记忆模块,有的快速响应实时输入数据,有的缓慢沉淀长期知识规律,通过层级化协作实现信息的高效处理与存储。

研究团队甚至发现,我们熟知的Transformer架构,本质上只是NL的简化版本,它的线性层结构相当于忽略了NL多层级协同的核心优势,并没有充分释放模型的潜力。

基于NL范式,研究团队推出了三大核心创新成果。

首先是深度优化器

像Adam、SGD这样的传统优化器,只会按固定的公式处理梯度,并不懂记忆和预判复杂的规律,调参容易陷入僵化。

而NL的深度优化器靠预处理机制提前分辨梯度性质、用MLP神经网络替代线性记忆来存储过往梯度规律,能够预判梯度变化、灵活调参。

其次是自我修改模型

让模型摆脱固定更新规则的束缚,在训练过程中自主学习“如何调整自身参数”,面对新领域数据时能灵活适配,无需人工干预修改架构。

最后是连续记忆系统

将传统模型的短期/长期记忆二元结构升级为多尺度记忆链,不同MLP模块按不同频率更新,分别负责存储短期细节与长期规律,实现类似人类的分层记忆管理。

而这些创新最终凝聚为Hope模型

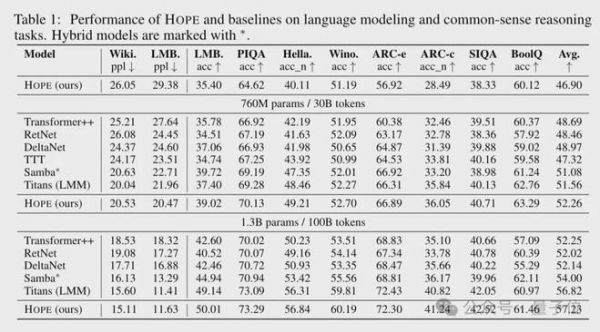

经过测试,在语言建模与常识推理任务中,从760M到1.3B参数规模的Hope,表现均大幅超越Transformer、RetNet、DeltaNet等主流基线模型。

在Wiki文本困惑度、PIQA物理常识推理、Winograd指代消解等多项指标上,Hope要么以更低的困惑度展现出更优的语言建模能力,要么以更高的准确率证明了更强的推理水平。

嵌套学习NL的提出,本质上是对深度学习核心架构的一次范式重构。

它跳出了堆层扩参的惯性思维,转而从认知科学中汲取灵感,让模型从扁平的计算网络进化为分层协作的智能系统。

这种全新的范式或许能让AI真正摆脱静态模型的桎梏,像人类一样在持续学习中积累经验、优化能力,也可能为大语言模型的终身学习、长上下文推理等关键难题提供全新的解决方案。

而在这样一项研究的团队名单里,令人欣喜的是出现了清华姚班校友钟沛林的名字。

钟沛林,2016年毕业于清华姚班,2021年拿到哥伦比亚大学的计算机博士学位。并且从2021年起,他就加入了谷歌纽约研究院,担任算法与优化团队的科学家。

实际上,在进入清华姚班之前,他就已经是一位竞赛达人。

据网友透露,钟沛林的外公曾说,当时还在上中学的小钟每到深夜某一时间闹钟响起,题库开放时,就会和全球的小伙伴一起编程做题。

2012年,小钟代表雅礼中学出征国际信息学奥林匹克竞赛,并获得当年的IOI金牌。和钟沛林同年获得金奖的,还有顾昱洲、李超以及同为雅礼中学学子的艾雨青。

有意思的是,钟沛林和艾雨青两人是发小,艾雨青还曾透露自己是在钟沛林的影响下,走上IOI之路,两人并肩成为了那一年雅礼中学的双子星,保送至清华姚班。

虽然在写NL这篇论文时,钟沛林尚在谷歌纽约研究院就职。

左:钟沛林 右:艾雨青

但目前,这对双子星已前后脚入职了Meta,分别担任AI科学家和软件工程师。

[1]https://x.com/JeffDean/status/1986938111839129858

[2]https://research.google/blog/introducing-nested-learning-a-new-ml-paradigm-for-continual-learning/

相关推荐

Jeff Dean:一年内 AI 将取代初级工程师,网友:“Altman只会画饼,Jeff说的话才致命”

谷歌内讧升级,员工联名要求Jeff Dean道歉,发生了什么?

姚期智和他的“姚班”:人生只为一大事而来

VC都在抢,无人不识姚班人

姚班天才创办的大模型公司,卖了

刚刚,Meta挖走OpenAI清华校友宋飏,任超级智能实验室研究负责人

终结Transformer统治!清华姚班校友出手,剑指AI「灾难性遗忘」

清华姚班的天才们,为何成为AI时代的配角

清华姚班是如何培养天才的?

人形AI捉迷藏惊煞网友:飞檐走壁纯靠自学,表情丰富还会合作,姚班学霸吴翼参与

网址: Jeff Dean盛赞姚班校友AI新研究,目前人已到Meta http://www.xishuta.com/newsview144324.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95792

- 2报告:抖音海外版下载量突破1 25736

- 3人类唯一的出路:变成人工智能 25175

- 4人类唯一的出路: 变成人工智 24611

- 5移动办公如何高效?谷歌研究了 24309

- 6华为 nova14深度评测: 13155

- 7滴滴出行被投诉价格操纵,网约 11888

- 82023年起,银行存取款迎来 10774

- 9五一来了,大数据杀熟又想来, 9794

- 10手机中存在一个监听开关,你关 9519