100倍AI推理能效提升,微软提出“模拟光学计算机”,研究登上Nature

人工智能(AI)和组合优化正在推动科学研究和工业应用的快速发展,但它们日益增长的能耗也对数字计算的可持续性提出了严峻挑战。

同时,目前大多数新型计算系统要么只擅长 AI,要么只擅长优化,而且还需频繁进行高能耗的数字转换,效率受限。另外,在实际应用中,这些系统也常难与硬件高效配合,无论是处理内存受限的神经网络、解决复杂优化问题,还是应对模拟计算噪声,都表现不佳。

如果换一种思路,不再依赖“0”与“1”的切换,而是用光与模拟信号去计算呢?这种不需要频繁转换、不依赖数字逻辑的计算方式,能否打破现有的限制?

基于此,微软英国剑桥研究院团队及其合作者提出了“模拟光学计算机”(Analog Optical Computer,AOC),其在无需数字转换的情况下,能够同时高效完成 AI 推理与组合优化任务,并具备显著的扩展潜力与能效优势。

相关研究论文已发表在权威科学期刊 Nature上。上海交大校友、微软英国剑桥研究院首席研究员褚嘉琦(Jiaqi Chu)为该论文的作者之一。

论文链接:https://www.nature.com/articles/s41586-025-09430-z

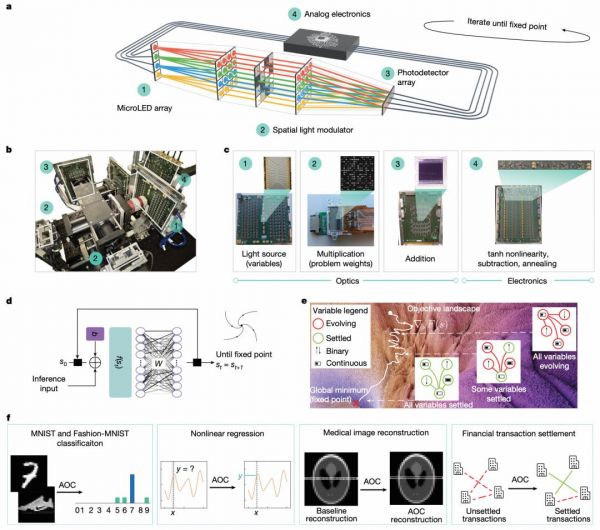

据介绍,AOC 实现了将模拟电子技术与三维光学技术相结合,使同一平台能够同时加速 AI 推理和组合优化任务。这种“双领域能力”得益于快速的定点搜索方法,无需数字转换,同时也增强抗噪声能力。基于这种定点抽象,AOC 可运行具备递归推理能力的新型计算密集型神经模型,并采用先进的梯度下降方法解决高表现力优化问题。

图|AOC 架构与应用示意图

研究团队表示,AOC 架构基于可扩展的消费级技术构建,为实现更高速、更可持续的计算提供了有前景的路径。其原生支持迭代式、计算密集型模型,为 AI 与优化领域的未来创新提供了可扩展的模拟计算平台。

模拟光学计算机:如何加速AI和优化任务?

AOC 在应用层面主要面向两类任务:机器学习推理任务和组合优化任务。研究团队通过四个典型案例展示了 AOC 在这两类任务中的能力。这项研究也体现了硬件与抽象层协同设计的优势,呼应了数字加速器与深度学习模型共同演进的趋势。

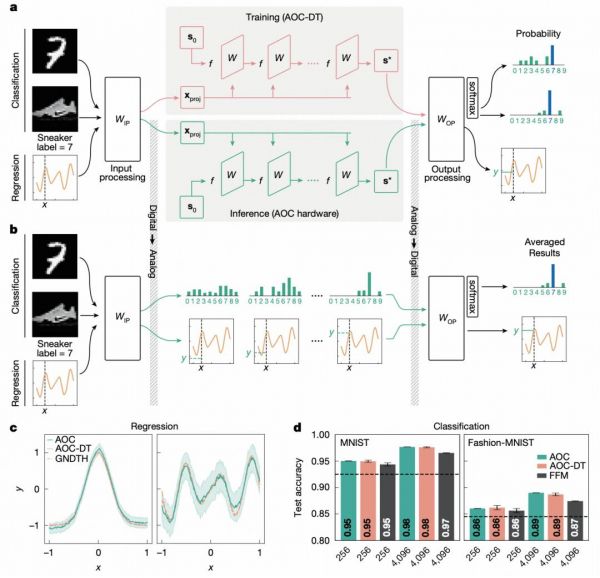

AOC 硬件结合了 3D 光学技术与模拟电子技术,并基于平衡模型实现了两个机器学习推理任务:图像分类与非线性回归。在这两项任务中,模型均通过 AOC-DT 进行数字训练,并直接部署到硬件上,无需进一步校准。这对硬件精度提出了较高要求,同时也要求 AOC-DT 具备较高的保真度。

在图像分类实验中,AOC 的结果证明了采用数字训练并将权重转移至光电模拟推理硬件的可行性。将 AOC 的结果与线性分类器进行比较时,运行在 AOC 上的平衡模型所作出的贡献更加明显。研究人员还训练了一个简单的前馈模型,线性分类器和前馈模型都具有与 AOC 硬件相同数量的参数。尽管 AOC 实现了略高的准确率,但 MNIST 和 Fashion-MNIST 数据集本身较为简单,难以充分展现自递归模型的全部潜力。

研究表明,AOC 硬件可以运行非线性回归模型。他们选择两个非线性函数进行回归:高斯曲线和正弦曲线。硬件准确地重现了这两个函数。相比高斯曲线,正弦曲线由于存在多个极小值和极大值,对拟合精度提出了更高要求,因此需要更高精度的可微分数字孪生模型(AOC-DT)。此外,AOC 为运行在硬件上的平衡模型提供了支持。

图|AOC 在机器学习推理中的应用

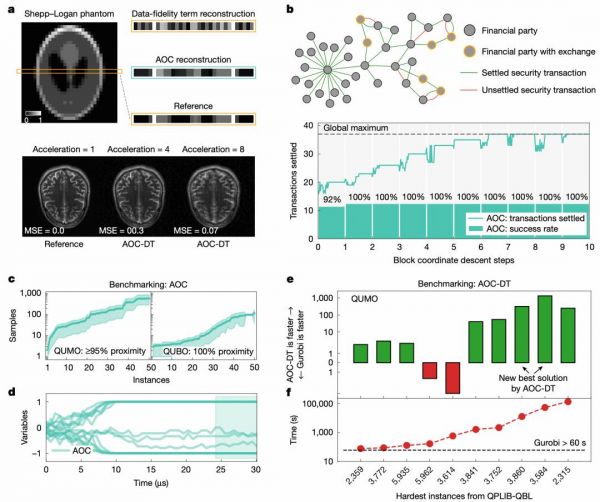

QUMO 代表了一类广泛的组合优化问题,旨在最小化目标函数,QUMO 问题的求解过程即为找到一组使目标函数最小化的变量赋值。研究团队在 AOC 硬件上展示了两个典型的 QUMO 应用场景:医学图像重建与金融交易结算。

他们在 AOC 硬件上实现了压缩感知,这是一种可以用更少的测量实现准确信号重建的技术。最终的图像重建结果与原始线条高度一致。所有 QUMO 实例均以完全模拟方式求解,未使用任何数字后处理。为了验证压缩感知在大规模下的 QUMO 表达形式,研究人员使用 AOC-DT 从 FastMRI 数据集中重建了一幅脑部扫描图像。这一问题包含超过 200000 个变量。在典型的 4 倍和 8 倍欠采样率下,重建的均方误差(MSE)均低于 0.07。

在金融领域的优化任务中,他们使用 AOC 硬件解决了一个交易结算问题。每一笔证券交易都是以支付换取证券的交换,清算所会处理这类交易的批次,在每个交易批次中,交易结算的目标是最大化已结算交易的总数或总价值。鉴于交易数量庞大,同时受到法律约束和其他附加要求的限制,这成为一项复杂的优化问题。在该交易结算场景中,AOC 硬件在 7 个块坐标下降法(BCD)步骤内找到了全局最优解。相比之下,量子硬件在相同问题上的成功率仅为 40–60%。

图|AOC 在优化中的应用

利用 AOC-DT,研究人员还在 QPLIB 基准测试中最难的具有线性不等式约束的二次二元问题上验证了算法性能,这些问题被表述为 QUMO 实例。AOC 方法与商用求解器 Gurobi 进行了对比,后者在这些问题上通常需要超过一分钟才能达到当前已知的最优解。

这种全模拟操作最大限度地减少了模数转换的开销。

未来潜力:实现100倍能效提升

值得注意的是,现实应用对硬件的扩展能力提出了更高要求。使用 AOC 处理实际任务,需要其硬件能够支持从数亿到数十亿个权重的可扩展性。

研究团队表示,AOC 通过模块化架构具备满足这一需求的潜力,该架构可将核心的光学矩阵–向量乘法运算分解为较小的子向量与子矩阵乘法,从而实现可扩展的内存计算。

研究团队预计,AOC 可支持参数规模在 1 亿至 20 亿之间的模型,对应需要 50 至 1000 个光学模块。如果单个光学模块能够同时处理正负权重,则所需模块数量可减少一半。AOC 所采用的所有组件,包括 microLED、光电探测器、SLM 及模拟电子器件,均已具备持续扩展的制造生态系统,能够支持晶圆级的生产。

AOC 的运行速度和功耗决定了其能效。其速度受光电组件带宽限制,通常为 2 GHz 或更高。对于一个 1 亿权重的矩阵,使用 25 个 AOC 模块时,功耗估计为 800 W,可实现 400 Peta-OPS 的计算速度,在 8 位权重精度下的能效为每瓦 500 TOPS。相比之下,最新的 GPU 在相同精度下处理稠密矩阵时,其系统能效最高仅为每瓦 4.5 TOPS。

总之,AOC 架构在扩展到实际的机器学习和优化任务方面展现出良好前景,有望在能效方面实现约 100 倍的提升。

展望未来,AOC 的协同设计方法——将硬件与机器学习和优化算法紧密对齐——有望持续推动硬件与算法的创新飞轮,这对实现可持续计算至关重要。

本文来自微信公众号“学术头条”(ID:SciTouTiao),作者:学术头条,36氪经授权发布。

相关推荐

微软推出模拟光学计算机,利用光子和电子来处理数据

谷歌量子霸权论文正式登上Nature,200秒顶超算10000年

微软新研究引发争议,AI能像人类一样推理?

真·机械朋克:物理学家用扬声器搭建神经网络,登上今日Nature

真空竟能热传导,甚至能传播声音!华人团队新研究突破认知,登上Nature

清华研究登Nature,首创全前向智能光计算训练架构,戴琼海、方璐领衔

最新研发模拟人工智能芯片:能效14倍于传统芯片提升语音识别效率

AMD公布疯狂芯片计划,用能效挑战英伟达会成功吗?

意念加AI算法「复原」每个手指,智能义肢登上Nature子刊封面

光芯片,火力全开

网址: 100倍AI推理能效提升,微软提出“模拟光学计算机”,研究登上Nature http://www.xishuta.com/newsview141452.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95792

- 2报告:抖音海外版下载量突破1 25736

- 3人类唯一的出路:变成人工智能 25175

- 4人类唯一的出路: 变成人工智 24611

- 5移动办公如何高效?谷歌研究了 24309

- 6华为 nova14深度评测: 13155

- 7滴滴出行被投诉价格操纵,网约 11888

- 82023年起,银行存取款迎来 10774

- 9五一来了,大数据杀熟又想来, 9794

- 10手机中存在一个监听开关,你关 9519