27 亿参数,微软发布 Phi-2 模型:某些性能指标优于 Llama-2-7B

IT之家 11 月 17 日消息,微软 Ignite 2023 大会已拉开帷幕,微软在本次活动中发布了旗下最小的语言模型 Phi-2,共有 27 亿参数,相比较此前版本有明显提升。

IT之家注:微软于今年 6 月发布 Phi-1,只有 13 亿代码,适用于 QA 问答、聊天格式和代码等等场景。该模型完全基于高质量数据进行训练,在基准测试中的表现比同类模型高出 10 倍。

微软今年 9 月更新发布了 Phi-1.5 版本,同样为 13 亿参数,可以写诗、写电子邮件和故事,以及总结文本。在常识、语言理解和推理的基准测试中,该模型在某些领域能够跟上多达 100 亿个参数的模型。

微软现在更新发布的 Phi-2 拥有 27 亿参数,规模虽然比此前版本翻番,但相比较其它主流语言模型,依然小很多。

微软表示 Phi-2 在逻辑推理和安全性方面显示出显著的改进。通过正确的微调和定制,小型语言模型是云和边缘应用程序的强大工具。

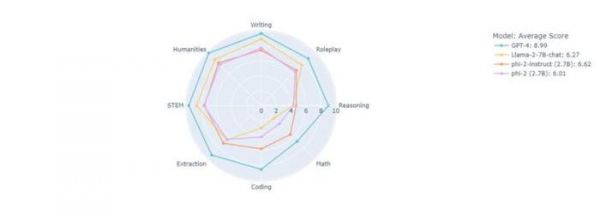

Microsoft Research 机器学习基础小组负责人 Sebastien Bubeck 在 Twitter 上发布了“MT-Bench”基准测试的屏幕截图,该基准测试了具有强大语言模型(例如 GPT-4)的大型和小型语言模型的实际功能。

根据结果,Phi-2 在某些方面优于 Meta 的 Llama-2-7B 模型。Phi-2 的聊天版本也在酝酿中,可能会解决该模型在这些领域的一些现有痛点。

发布于:山东

相关推荐

微软900亿血赚!GPT-4模型搜索能力优于谷歌

微软发布史上最大AI模型:170亿参数横扫各种语言建模基准,将用于Office套件

夸克发布自研千亿级参数大模型

强大如GPT-3,1750亿参数也搞不定中文?

GPT-4是8x2200亿参数的混合模型?这个小道消息今天传疯了

微软牵手Meta,大模型竞争来到新起点

扎克伯格搞免费开源,搅动大模型池水

阿里云发布了第二款140亿参数开源模型,免费可商用 | 最前线

中国电信发布千亿参数“星辰”大模型,明年 4 月开源

Meta用“免费版ChatGPT”打响翻身仗,还把微软拉上了船

网址: 27 亿参数,微软发布 Phi-2 模型:某些性能指标优于 Llama-2-7B http://www.xishuta.com/newsview98267.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95792

- 2报告:抖音海外版下载量突破1 25736

- 3人类唯一的出路:变成人工智能 25175

- 4人类唯一的出路: 变成人工智 24611

- 5移动办公如何高效?谷歌研究了 24309

- 6华为 nova14深度评测: 13155

- 7滴滴出行被投诉价格操纵,网约 11888

- 82023年起,银行存取款迎来 10774

- 9五一来了,大数据杀熟又想来, 9794

- 10手机中存在一个监听开关,你关 9519