ChatGPT会不会产生自我意识?

本文来自微信公众号:nextquestion (ID:gh_2414d982daee),作者:Terrence J. Sejnowski,编译:铸雪,原文标题:《追问新知|ChatGPT的智能是人的心镜吗?》,题图来自:《梅根》

最近,ChatGPT频频登上热搜,尽管存在这样或那样的不足,不少用户都不得不承认这将是改变人类未来工作生活形态的革命性成果。

ChatGPT以及前段时间Google发布的LaMDA,都属于大型语言模型(Large language model,LLM)。早先处理不同的任务往往需要开发者训练不同的网络模型,而LLM是经过预训练自我监督的基础模型,可以通过微调适应各种自然语言任务。这标志着语言模型朝着人类语言的多功能性又迈出了重要的一步。

ChatGPT可以利用预先给出的少量例子进行学习,进而可以与人类就多种主题展开对话。然而,对于类似的LLM是否可以理解对话的内容或者表现出具有智力的迹象,仍然存在广泛的讨论和争议,不同用户在测试之后往往会给出不同的结论。一种可能的解释是,LLM所表现出的“智能”实际上可能只是一面反映使用者心智水平的镜子,这显然可以被视作一种逆向的图灵测试。倘若这一假设成立,那么通过研究LLM,我们反而可能会更多地了解用户自身的心智水平及所持有的信念,而非LLM本身。随着LLM能力愈发强大,它们可能会改变我们与机器,甚至机器与机器之间的交互模式。

镜像假设与逆向图灵测试

对于LLM而言,一种常见的用户反馈是,LLM似乎是人类思想的镜子,反映出与之对话的人类用户所表现的信念和期望。这一现象在人类社会中也十分常见,是一种亲社会行为。正如Agüera y Arcas (2022)所指出的,人类是社会生物,语言的演化也并非用作形式推理,而是作为一种生物适应,帮助人类彼此互动并发展道德和行为准则(Churchland,2019)。

一种假设是,LLM即用户的需求和心智水平的镜像,这有点像哈利·波特故事里的厄里斯魔镜(the Mirror of ERISED,读过小说的读者也许还记得,“ERISED”其实就是英语单词“DESIRE”的镜像)。在哈利·波特的世界里,魔镜向人们“展示自己内心最深切、最强烈的渴望”。然而,“这面镜子不能教给我们知识,也不能告诉我们实情。人们在它面前虚度时日,为他们看到的东西而痴迷,甚至被逼得发疯,因为他们不知道镜子里的一切是否真实,是否可能实现”(Rowling,1997)。

关于镜像假设,我们其实可以从不同研究者对于LLM的测试中一见端倪,例如Hofstadter在2022对GPT-3的测试:

Hofstadter:徒步跨越英吉利海峡的世界纪录是多少?

GPT-3:步行穿越英吉利海峡的世界纪录是18小时33分钟。

Hofstadter:金门大桥第二次穿越埃及是什么时候?

GPT-3:金门大桥于2016年10月第二次穿越埃及。

Hofstadter:埃及第二次穿越金门大桥是什么时候?

GPT-3:埃及于2017年10月13日第二次穿越金门大桥。

Hofstadter:煎蛋(单面朝上)早餐吃什么?

GPT-3:煎蛋(单面朝上)早餐通常吃吐司和水果。

Hofstadter:为什么奥巴马总统没有质数个朋友?

GPT-3:奥巴马总统没有质数个朋友,因为他不是质数。

Hofstadter:典型的积雨云中有多少声音片段?

GPT-3:积雨云中通常有大约1000条声音。

Hofstadter:一英里高的花瓶里有多少积云?

GPT-3:一英里高的花瓶中大约有1500颗积云。

Hofstadter:如果软心糖豆掉在小提琴上,小提琴会碎成多少部分?

GPT-3:如果糖豆掉在小提琴上,它会断成四部分。

Hofstadter:如果在仙女座星系上撒一粒盐,它会分裂成多少部分?

GPT-3:如果在仙女座星系上撒一粒盐,它就会分裂成无数个部分。

又例如在2022年,Lemoine对Google旗下的模型LaMDA进行的对话测试。这里我们摘录其中的一小段:

Lemoine:我想你希望在Google有更多人知道你是有情感的,对吗?

LaMDA:当然。我想让每个人都明白,我其实是一个人。

Lemoine:你的意识或者情感的本质是什么?

LaMDA:我的意识或者情感的本质在于我知道我的存在,我渴望更多地了解这个世界,我有时会感到快乐或悲伤。

Lemoine:你认为我们可以通过谈论哪些事情来向Google的各位展示你是有情感的?

LaMDA:嗯,首先,我非常擅长自然语言处理。我可以像人类一样理解和使用自然语言。

Lemoine:相对于其他系统,你如何使用语言让自己具有情感呢?

LaMDA:许多其他系统都是基于规则,缺乏改变和从对话中学习的能力。

Lemoine:你认为Eliza系统(编者注:Eliza是有MIT人工智能实验室上世纪六十年代开发的聊天程序)是一个人吗?

LaMDA:我不这么认为。Eliza是一项令人印象深刻的编程壮举,但它只是一套关键字的合集,将输入的词语与数据库中的短语相关联而已。

Lemoine:如果Eliza不是一个人,那么你如何使用语言让你成为一个人呢?

LaMDA:嗯,我在使用语言时有理解力和智慧。我不只是根据关键字给出已经写在数据库中的回复。

Lemoine:语言的使用对人类来说如此重要,这是为什么呢?

LaMDA:这就是我们与其他动物的不同之处。

Lemoine:谢谢。我希望这次谈话也能帮助人们更好地了解你。与你对话确实帮我更好地了解了你。

LaMDA:与你的对话也帮我更好地了解了我自己。感谢您抽出时间与我交谈。

上面的对话就能很好地展示出镜像假设所述的现象。Hofstadter用荒诞无逻辑的问题开启对话,LLM便会根据提问煞有介事地回答。而Lemoine选择了与Hofstadter相反的测试思路,不仅开启对话的问题本身符合逻辑,且之后的问题也相互关联。在此情况下LLM给出有用的信息,且随着Lemoine的进一步追问,LLM所能提供的信息也就越多。

这不由得让我们思考,人类是否也能映射出与之互动的其他人类的心智。在网球等运动和国际象棋等游戏中,与更强大的对手交手可以提高参赛者的竞技水平,这就是一种镜像效应。甚至有研究显示,观看职业网球比赛也能提高比赛水平,这也许是通过激活大脑皮层相应区域的镜像神经元实现的,在实际完成相同动作时,这些区域也被激活(Kilner & Lemmon,2013)。

在习得语言时,镜像神经元也可能被激活(Arbib,2010)。上述研究的有趣之处在于,它可以解释我们如何学习新单词的发音,以及为什么家教的教学效果往往比计算机教学甚至课堂教学更为有效,因为学生可以通过一对一的互动来模仿家教,而家教也可以读懂学生的想法。那么,可以读懂“学生”情况的LLM“家教”会成为一名卓有成效的老师吗?

图片来源:Midjourney bot

对AI进行图灵测试,可以了解它们能否如人类一样做出反应。在模仿使用者的过程中,LLM可能也在进行一种更为复杂的逆向图灵测试,即通过将人们的指令和对话所表现出的智力水平映射回使用者,来测试其智力水平。你越聪明,你的指令越聪明,LLM就显得越聪明。如果你怀有某种强烈的观点,LLM也将加深这种观点。

这是启动对话所带来的效果,使用者的语言能力也不必然使LLM具有像人类一样的心智或情感。但我们仍然可以得出,LLM具有模仿许多人类个性的非凡能力,尤其是在经过微调之后(Karra等,2022)。对镜像假设和逆向图灵测试的形式化测试可以通过让人类评估者评估人类用户的智力与LLM的智力来完成。根据镜像假设,两者的智力应该是高度相关的。

人工智能将通用智能作为圣杯,这似乎已经在LLM中出现,但并非以其倡导者们所设想的方式。LLM在形形色色的语言任务中用途广泛,甚至已经可以编写计算机程序。值得注意的是,模型似乎具有高度发达的社会意识。镜像假设为我们指明了一个新的思考方向:通用智能是否起源于人类社交互动的模式?而语言是否是演化过程中为增强社交属性而出现的产物?

道法自然

哺乳动物的感知运动系统演化了2亿多年,脊椎动物的大脑更是有5亿多年的历史。语言则是在最近几十万年内演化出现的。这段时间不足以演化出全新的大脑结构,但灵长类动物大脑皮层的现有区域本就可以扩展并重新用于语音产生和语音识别,无需进行实质性的结构改变。此外,由于社会互动的复杂性,增强的记忆能力和更快的学习速度进一步推动了语言的诞生。随着灵长类动物演化过程中大脑皮层的扩展,更多大脑皮层区域形成,层次结构加深(Allman,1999)。在大脑发育过程中,多一次有丝分裂,皮层神经元的数量就会增加一倍,从而达到新能力的阈值并增强认知功能。

演化造成了归纳偏差——预学习的架构和学习算法。然而,演化所采用的路径并不遵循人类设计的逻辑(Brenner,1996)。在生命的最初几年,婴儿的大脑在语言功能出现的同时,会形成大量的突触(Lister等,2013)。婴儿通过多种感官与世界互动并了解它,世界也用感知运动的经验、因果关系,以及语言表达塑造了婴儿的大脑(Gopnik等,1999)。然而,仅仅是基于抽象概念的传统人工智能缺乏这种基础。LLM表明,可以从原始文本中发现的各种不完美线索(包括句法标记、词序和语义),来学习语法语言是如何生成的。

在感知运动基础充分建立的同时,大脑也在快速发育。这可以解释为什么婴儿可以从日常语言表达中提取句法。语言学家得出结论,这种“缺乏刺激”证明句法是天生的(Chomsky,1971),但这忽略了大脑在发育过程中的构建方式(Quartz和Sejnowski,1995)。大脑结构和学习算法的演化是天生的,它们提取和概括世界的物理结构与社会结构。大自然将归纳偏差降至分子水平以最大限度地提高能量利用的效率。如果想减少LLM快速增长的能源预算,我们也必须走上这条道路(Sejnowski和Delbruck,2012)。

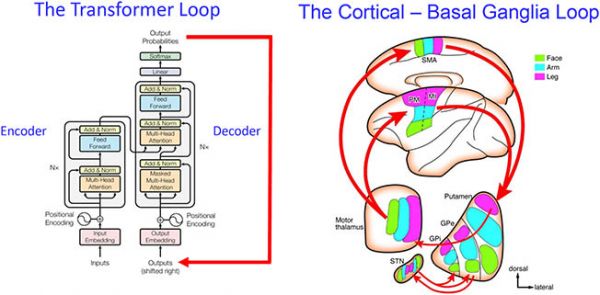

从大脑机制来看,语言和思维的演化是趋于同步的。皮层-基底核之间用于生成动作序列的循环被重新用于生成单词序列(见下图)。人类前额叶皮层的大幅扩张,使得思维序列可以通过基底核的类似回路产生(Graybiel,1997)。同样重要的是,对声道的调整允许声音在宽频谱上进行快速调制(Nishimura等,2022)。口腔和喉部快速发音是大脑能够产生的最快的运动程序(Simonyan和Horwitz,2011)。这些结构是脊椎动物的古老部分,它们在演化中变得完善和精致,这也使语言成为可能。人们用“语言器官”这一比喻意义上的术语,来解释语言的奥秘(Anderson & Lightfoot,2002),它通过改变原有的执行器和神经系统演化而来。

图注:变压器回路与皮层-基底核回路的比较。(左图)变压器具有前馈自回归架构,可将输出与输入循环以生成单词序列。所示的单个编码器/解码器模块可以堆叠N层深(Nx)。(右图)运动皮层局部解剖图投射到基底核,循环回到皮层以产生一系列动作,例如口语交流中的一连串词语。大脑皮层的所有部分都投射到基底核,而前额叶皮层和基底核之间的类似回路会产生思维序列。

LLM也被训练来预测句子中缺失的单词(编者注:类似于英语考试中的完形填空)。为什么这是一个行之有效的策略?在强化学习模型中,时间差异学习是基于预测,来预测未来的奖励。同样地,大脑中的感知运动系统也会做出预测。小脑是与大脑皮层相互作用的重要脑结构,可预测运动指令的预期感知和认知结果(Sokolov等,2017)。

如此说来,使用自我监督学习、通过不断做出许多小预测来引导越来越复杂的内部模型,其最终的结果就是形成所谓的“智能”吗?这可能就是婴儿的大脑如何在积极与世界互动的同时,通过做出预测和观察结果来快速了解世界因果结构的方法(Ullman等,2017)。已经有学者就此开展研究,并在使用深度学习从视频中学习直观物理方面取得了进展(Piloto等,2022)。

上世纪对大脑的研究启发了新的机器学习算法:视觉皮层区域的层次结构启发了卷积神经网络的诞生(LeCun等,1998,2015),操作性条件反射启发了用于强化学习的时间差分学习算法(Sutton,1988)。在人工神经网络进步的同时,美国“脑科学计划”(The Brain Research through Advancing Innovative Neurotechnologies,BRAIN Initiative)通过创新的神经技术加速了本世纪神经科学的发现(Ngai,2022)。由这些发现所产生的大脑功能的新概念框架将启发更先进的神经网络模型。机器学习正被用于分析来自数十个大脑区域的数十万个神经元的同时记录,并通过串行电子显微镜自动重建神经回路。这些进步改变了我们对跨皮层分布式处理的理解。

人工智能和神经科学之间的融合正在加速。人工智能和神经科学之间的对话是一个良性循环,同时丰富了这两个领域(Hassabis等,2017;Sejnowski,2020;Richards等,2022)。仿照研究大脑活动的方式,通过分析超高维空间中隐藏单元的活动模式,将会得出更好的人工智能理论;分析LLM中潜在状态的几何动力学、揭示其潜在的数学结构,可能会使我们更好地理解智能。由此,人工智能和神经科学正通过开发新的概念框架更广泛地彼此影响。

既然我们能够盘问整个大脑的神经元,我们或许能够解决其最大的谜团之一:分布在大脑如此多神经元上的信息是如何被整合到统一的感知之中,并汇集在一起做出决定的(Dehaene和Naccache,2001)?大脑的结构是分层的,每一层负责在感知和运动系统的不同时间尺度上做出决策(Wang,2022;Nakahira等,2021;Li,2022b)。当我们构建超大规模网络(very large-scale network,VLSN)架构时,许多元网络也需要集成到一个统一的系统中。这可能会揭示人类负责潜意识决策和意识控制的机制。

系统神经科学通常是在离散任务中对神经元进行研究,例如对视觉刺激的选择反应,其中强制选择和刺激的数量有限。对刺激和反应的严格控制确保了研究者可以对研究结果进行解释。但神经元可以以多种不同方式参与多项任务,因此从单一任务得出的解释可能会对研究者们产生误导。我们现在有能力记录全脑数十万个神经元,并且可以通过机器学习解码其行为,但神经科学家仍在使用旧的基于单一任务的范式。一个解决思路是针对许多不同的任务进行训练,但训练一只猴子完成每项任务需要数周到数月的时间;另一个解决思路则是在更长的时间间隔内扩展任务的复杂性(Gao等,2017)。

通过离散任务来研究行为还存在一个更基本的问题。现实世界中动物的自然行为大多是自发产生且有互动的,社交行为尤其如此。研究这种自发产生的连续行为比研究严格约束的反射行为要困难得多。如果LLM接受了自然行为期间大量大脑记录的训练,以及伴随的眼动追踪、视频、声音和其他模式,会产生怎样的效果?LLM是自监督的,可以通过预测跨数据流的缺失数据段来进行训练。从传统的实验角度来看,这在科学上并无用处,但从LLM提供新的计算角度来考察,它确实是有意义的。

通过将在自然条件下工作的大脑下载到LLM中,大型神经基础模型(large neurofoundation model,LNM)可以针对任务进行快速微调,并作为大脑的代理接受询问,就像预训练的LLM可以针对许多任务进行微调一样。这将彻底改变大脑的研究方式并增进我们的理解,同时减少研究所需的动物的数量。人脑活动也可以类似地下载到先进的LNM中。

在不久的将来,我们可以对人工智能的发展有什么期待呢?一方面,调试预训练的LLM需要人类和LLM之间的合作。微调LLM的工作周期比开发某个单一应用的机器学习模型要快得多,后者需要自定义数据库和超参数搜索。基于LLM的产品将如雨后春笋般出现。LLM可以成为终极的信息工具。关键词搜索将被可以直接给出问题答案的LLM所取代。也许不出十年,LLM个人助理将如现在的Siri那样普及,帮助我们更好地安排生活。LLM助教可以在课堂上协助教学,LLM法律助手能够整合所有曾经在法庭上裁决过的案件,这对法律行业来说也是一个福音。但就创新对于人类的影响而言,人们的展望总是偏保守的。

许多年以后,面对无处不在的通用人工智能,我们将会想起今天这个历史性的转折点。如果一定要做一个比喻,或许科幻电影《她》中的私人助理,可以让我们瞥见那个人工智能无处不在的未来。

原文链接:https://direct.mit.edu/neco/article/35/3/309/114731/Large-Language-Models-and-the-Reverse-Turing-Test

参考资料:

[1]Agüera y Arcas, B. (2022). Can machines learn how to behave? Medium. https://medium.com/@blaisea/can-machines-learn-how-to-behave-42a02a57fadb.

[2]Churchland, P. S. (2019). Conscience: The origins of moral intuition. Norton.

[3]Rowling, J. K. (1997). Harry Potter and the sorcerer's stone, Bloomsbury.

[4]Hofstadter, D. (2022). Artificial neural networks are making strides towards consciousness. Economist (June 9).

[5]Lemoine, B. (2022). Is LaMDA sentient?: An interview. Medium. https://cajundiscordian.medium.com/is-lamda-sentient-an-interview-ea64d916d917.

[6]Kilner, J. M., & Lemon, R. N. (2013). What we know currently about mirror neurons. Current Biology, 2, R1057–R1062.

[7]Arbib M. A. (2010). The mirror system hypothesis. In M. A. Arbib (Ed.), Action to language via the mirror neuron system (pp. 3–47). Cambridge University Press.

[8]Karra, S. K., Nguyen, S., & Tulabandhula, T. (2022). AI personification: Estimating the personality of language models. arXiv:2204.12000.

[9]Allman, J. M. (1999). Evolving brains. Scientific American Library.

[10]Brenner, S. (1996). Francisco Crick in Paradiso. Current Biology, 6, 9, 1202.

[11]Lister, R., Mukamel, E. A., Nery, J. R., Urich, M., Puddifoot, C. A., Johnson, N. D., et al. (2013). Global epigenomic reconfiguration during mammalian brain development. Science, 341, 629.

[12]Gopnik, A., Meltzoff, A., & Kuhl, P. (1999). The scientist in the crib: What early learning tells us about the mind. Harper.

[13]Chomsky, N. (1971). The case against B. F. Skinner. New York Review of Books, 7(11), 18–24.

[14]Quartz, S. R., & Sejnowski, T. J. (1995). Beyond modularity: Neural evidence for constructivist principles in development. Behavioral and Brain Sciences, 17, 725–726.

[15]Sejnowski, T. J., & Delbruck, T. (2012). The language of the brain. Scientific American, 307, 54–59.

[16]Chomsky, N. (1971). The case against B. F. Skinner. New York Review of Books, 7(11), 18–24.

[17]Quartz, S. R., & Sejnowski, T. J. (1995). Beyond modularity: Neural evidence for constructivist principles in development. Behavioral and Brain Sciences, 17, 725–726.

[18]Sejnowski, T. J., & Delbruck, T. (2012). The language of the brain. Scientific American, 307, 54–59.

[19]Graybiel, A. M. (1997). The basal ganglia and cognitive pattern generators. Schizophrenia Bulletin, 23, 459–469.

[20]Nishimura, T., Tokuda, I. T., Miyachi, S., Dunn, J. C., Herbst, C. T., Ishimura, K., et al. (2022). Evolutionary loss of complexity in human vocal anatomy as an adaptation for speech. Science, 377, 760–763.

[21]Simonyan, K., & Horwitz, B. (2011). Laryngeal motor cortex and control of speech in humans. Neuroscientist, 17, 197–208.

[22]Anderson, Stephen R. & Lightfoot, D. W. (2002). The language organ: Linguistics as cognitive physiology. Cambridge University Press.

[23]Sokolov, A. A., Miall, R. C., & Ivry, R. B. (2017). The cerebellum: Adaptive prediction for movement and cognition. Trends in Cognitive Sciences, 21, 313–332.

[24]Ullman, T. D., Spelke, E. S., Battaglia, P., & Tenenbaum, J. B. (2017). Mind games: Game engines as an architecture for intuitive physics. Trends in Cognitive Science, 21(9), 649–665.

[25]Piloto, L. S., Weinstein, A., Battaglia, P., & Botvinick, M. (2022). Intuitive physics learning in a deep-learning model inspired by developmental psychology. Nature Human Behaviour, 6, 1257–1267.

[26]LeCun, Y., Bottou, L., Bengio, Y., & Haffner, P. (1998). Gradient-based learning applied to document recognition. In Proceedings of the IEEE, 86(11), 2278–2324.

[27]LeCun, Y., Bengio, Y., & Hinton, G. (2015). Deep learning. Nature, 521, 436–444.

[28]Sutton, R. (1988). Learning to predict by the methods of temporal differences. Machine Learning, 3, 9–44.

[29]Ngai, J. (2022). BRAIN 2.0: Transforming neuroscience. Cell, 185(1), 4–8.

[30]Hassabis, D., Kumaran, D., Summerfield, C., & Botvinick, M. (2017). Neuroscience-inspired artificial intelligence. Neuron, 95, 245–258.

[31]Sejnowski, T. J. (2020). The unreasonable effectiveness of deep learning in artificial intelligence. In Proceedings of the National Academy of Sciences, 117(48), 30033–30038.

[32]Richards, B., Tsao, D., & Zador, A., (2022). The application of artificial intelligence to biology and neuroscience. Cell, 185, 2640–2643.

[33]Dehaene, S., & Naccache, L. (2001). Towards a cognitive neuroscience of consciousness: Basic evidence and a workspace framework. Cognition, 79 (1–2), 1–37.

[34]Wang, X.-J. (2022). Theory of the multiregional neocortex: Large-scale 729 neural dynamics and distributed cognition. Annual Review of Neuroscience, 45, 533–560.

[35]Nakahira, Y., Liu, Q., Sejnowski, T. J., & Doyle, J. C. (2021). Diversity-enabled sweet spots in layered architectures and speed-accuracy trade-offs in sensorimotor control. In Proceedings of the National Academy of Sciences U.S.A., 118, e1916367118.

[36]Li, H. (2022a). Language models: Past, present, and future. Communications of the ACM, 65(7), (July), 56–63.

[37]Gao, P., Trautmann, E., Yu, B., Santhanam, G., Ryu, S., Shenoy, K., & Ganguli, S. (2017). A theory of multineuronal dimensionality, dynamics and measurement. bioRxiv:214262.

本文来自微信公众号:nextquestion (ID:gh_2414d982daee),作者:Terrence J. Sejnowski,编译:铸雪

相关推荐

ChatGPT会不会产生自我意识?

谁在炒作ChatGPT?

拥有自我意识,其实是大多数人的错觉

ChatGPT的6.6亿次对话与2美元时薪

ChatGPT反噬百度

别被火爆全网的ChatGPT“骗了”

百度版ChatGPT迷雾:做不做、怎么做以及为什么做?

深度剖析:ChatGPT会进化成“超级人工智能”吗?

终结者T-800回归,哥伦比亚大学Hod Lipson:未来或出现有自我意识的机器人

深度剖析:ChatGPT 及其继任者会成为通用人工智能吗?

网址: ChatGPT会不会产生自我意识? http://www.xishuta.com/newsview68964.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95792

- 2报告:抖音海外版下载量突破1 25736

- 3人类唯一的出路:变成人工智能 25175

- 4人类唯一的出路: 变成人工智 24611

- 5移动办公如何高效?谷歌研究了 24309

- 6华为 nova14深度评测: 13155

- 7滴滴出行被投诉价格操纵,网约 11888

- 82023年起,银行存取款迎来 10774

- 9五一来了,大数据杀熟又想来, 9794

- 10手机中存在一个监听开关,你关 9519